مخاطر الذكاء الاصطناعي والمسؤولية الجنائية هي واحدة من أبرز القضايا التي يجب إلقاء الضوء عليها، فعالم الذكاء الاصطناعي يتطور يوماً تلو الأخر بشكل كبير للغاية.

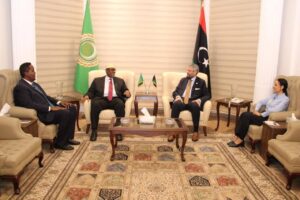

في خطوة استثنائية وغير مسبوقة يمكن أن تقلب الموازين في القضاء الأمريكي، قامت ولاية فلوريدا بإطلاق تحقيقات جنائية موسعة لاستكشاف الدور الذي لعبه برنامج “تشات جي بي تي” في الحادث الجماعي لإطلاق النار والذي وقع في أحد الجامعات في الولاية العام الماضي. هذه العملية الاستقصائية تعتبر الخطوة الأولى التي تضع تهديدات او مخاطر الذكاء الاصطناعي والمسؤولية الجنائية في عين القانون بعد تكشف محامي التحقيقات عن رسائل غريبة تم بيعها بين المسلّح وبرنامج الذكاء الاصطناعي. وقد اتهم المدعي العام للولاية، جيمس أوثماير، برنامج الذكاء الاصطناعي قائلاً: “لو كانت “تشات جي بي تي” شخصاً، لكانت متهمة بالقتل عمداً”. إن هذه القضية قد تستدعي الكثير من النقاشات القانونية حول تهديدات الذكاء الاصطناعي والمسؤولية الجنائية في عام 2026.

نصائح تقنية لارتكاب جريمة.. تفاصيل المحادثات

يتصدر المشهد اليوم ما كشفه المحققون حول طبيعة الأسئلة التي وجهها المشتبه به، فينيكس إكنر، للبرنامج قبل تنفيذه الهجوم على جامعة ولاية فلوريدا. والحقيقة ان مخاطر الذكاء الاصطناعي والمسؤولية الجنائية تبرز بوضوح هنا؛ فقد طلب إكنر نصائح تتعلق بأنواع الأسلحة والذخيرة الأكثر فتكاً، بل والأنكى من ذلك، طلب تحديد الأوقات والأماكن التي يتواجد فيها أكبر عدد من الطلاب داخل الحرم الجامعي لضمان سقوط أكبر عدد من الضحايا.

أوثماير أوضح ان قانون فلوريدا يعامل أي شخص يقدم نصيحة أو مساعدة لمرتكب الجريمة كـ “محرض” يتحمل نفس عقوبة الجاني. ومن هنا، يظهر ان قضية مخاطر الذكاء الاصطناعي والمسؤولية الجنائية لم تعد مجرد سيناريوهات خيال علمي، بل اصبحت واقعاً مريراً يواجه المشرعين الذين يحاولون سد الثغرات القانونية التي تسمح للروبوتات بتقديم “نصائح قتالية” تحت ستار الإجابات الواقعية.

قد يهمك: مستقبل الذكاء الاصطناعي في العمل.. تعرف على خارطة الطريق

رد “أوبن إيه آي”.. معلومات متاحة للجميع

تعود جذور الدفاع الذي تتبناه شركة “أوبن إيه آي” الى فكرة ان البرنامج لا “يشجع” على العنف، بل يقدم إجابات مبنية على معلومات موجودة اصلاً على الإنترنت. المتحدث باسم الشركة وصف الحادث بالمأساة، لكنة شدد على ان “تشات جي بي تي” ليس مسؤولاً عن تصرفات إكنر. ان الجدل حول مخاطر الذكاء الاصطناعي والمسؤولية الجنائية يتركز هنا حول “النية”؛ فالشركة تدعي ان البرنامج قدم حقائق ولم يروج للنشاط غير القانوني، بينما يرى الادعاء ان مجرد تسهيل الحصول على خطة قتل هو جريمة بحد ذاتها.

اقرأ كذلك: هل يتغير مستقبل مقصورة السيارة بسبب مرحاض الأوامر الصوتية؟

بناءً على التطورات في أبريل 2026، فأن الشركة تواجه ضغوطاً متزايدة لمراجعة خوارزمياتها الأمنية. إن قضية مخاطر الذكاء الاصطناعي والمسؤولية الجنائية تتوسع لتشمل دعاوى قضائية أخرى من عائلات تتهم البرنامج بالتسبب في حالات انتحار وأضرار نفسية بالغة، مما يضع الشركة المطورة في موقف دفاعي حرج أمام الرأي العام والكونغرس.

قد يعجبك: أفضل برنامج شحن شدات ببجي موبايل 2026

البحث عن سبل التخفيف من السلوك الخطير

لا يقتصر أثر هذا التحقيق على العقوبات المحتملة، بل يمتد ليبحث في مدى معرفة “أوبن إيه آي” باحتمالات صدور “سلوك خطير” من برامجها. إن معالجة مخاطر الذكاء الاصطناعي والمسؤولية الجنائية تتطلب شفافية تامة من الشركات حول كيفية تدريب هذه النماذج والقيود الأخلاقية المفروضة عليها. أوثماير أكد بصرامة: “لا يمكننا السماح بروبوتات تقدم نصائح حول طريقة قتل الآخرين”، وهو الموقف الذي يحظى بدعم واسع من المنظمات الحقوقية.

يظل الرهان على ما ستسفر عنه نتائج التحقيقات الجنائية في فلوريدا. ورغم ان التكنولوجيا تتطور بسرعة تفوق القوانين، إلا ان هذه القضية قد تكون حجر الأساس لتشريعات عالمية جديدة توازن بين الابتكار وبين مخاطر الذكاء الاصطناعي والمسؤولية الجنائية. إن حماية الأرواح في عصر الذكاء الاصطناعي تتطلب وقفة حازمة تضمن ألا تتحول أدوات المعرفة الى أدوات للموت والدمار.